WIDE OPEN MV幕後大解析

最近這支化學兄弟的 MV 《Wide Open》 很夯,在避免又有客戶看到這支,隨便拍了一支自己感覺很有 FU 的影片想發來要做類似的特效,所以寫了這篇分享。

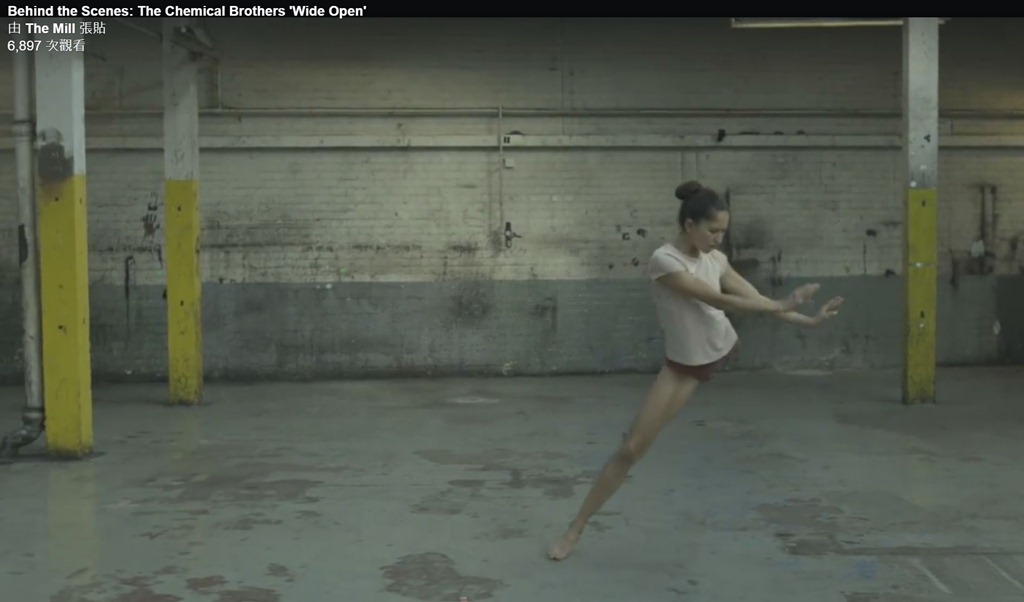

可能有人會認為這是很簡單的效果,只是局部換掉實拍舞者的肢體,而且一鏡到底很好拍,在有這個念頭之前有些幕後細節你可能要先知道,以下都是 MV 製作公司英國 The Mill 官方文章有憑有據,非隨口唬爛。先來看看正片~

MV -Wide Open ft. Beck

「很多時候看起來愈樸素自然的鏡頭反而要下的功夫愈是龐大到令人無法想像。」

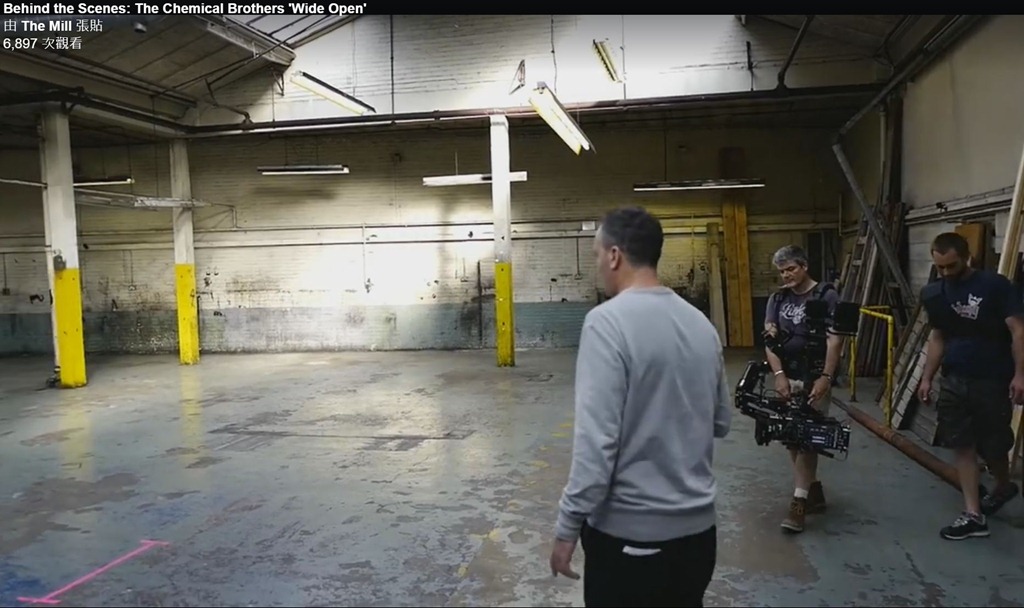

絕對不是找個廢墟,約個會跳舞的正妹,找台5D 或 A7 (高畫質數位單眼相機)拿起來開始拍,拍完再找個 3D 動畫師說幫我貼回去,貼的跟這支影片一樣簡單好看就好…。再來看看幕後花絮~

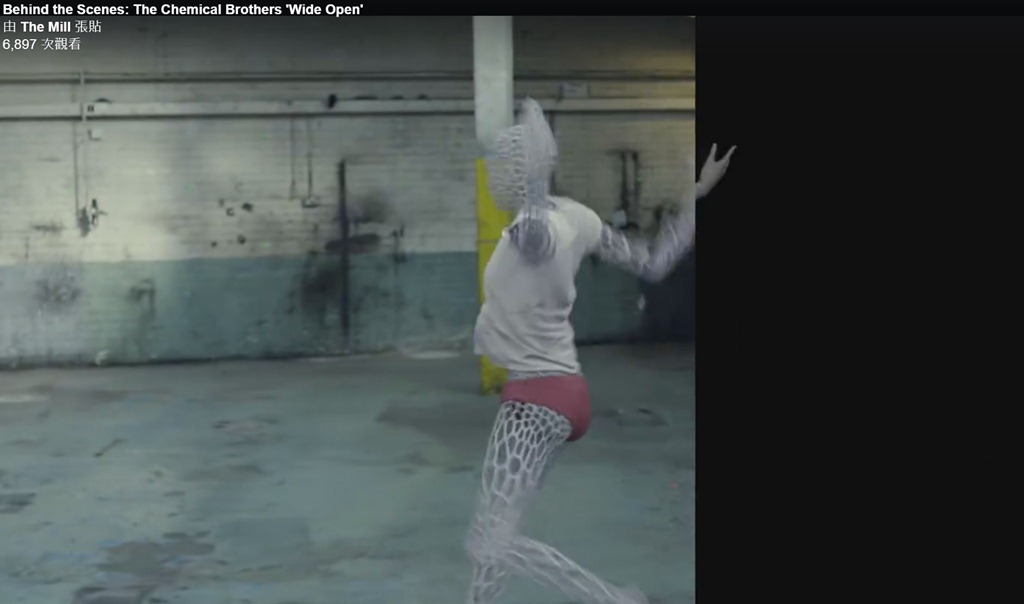

The Mill 製作的幕後花絮

重點1 場景

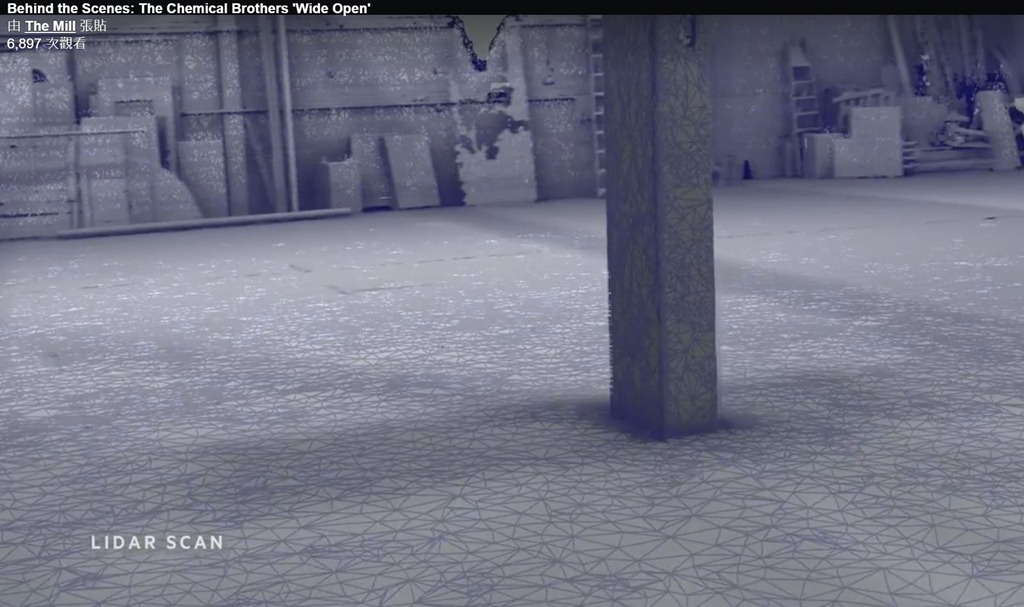

利用 LIDAR 掃瞄出來的 3D 環境檔案搭配實拍影片做投影貼圖與研發工具 + 搭配實拍底圖混合而成。

LIDAR 英文全名是 Light Detection and Ranging ,一種光學測距的 3D 遠程掃描方法,常常都是使用空拍機進行,一開始的用途是幫助科學家取得地表、海岸、人造建築、甚至是龍捲風的精確立體數據做研究,一般來說都會至少由三個物件組成:測距雷射、掃描器、GPS 定位儀。後來則廣泛使用於視覺特效領域取代過往必須用手工重建 3D 環境,更精確也更有效率。(編)

重點2 舞者 TRACKING

(1) 使用 ARRI 原廠的 LDS 鏡頭來記錄精確的焦段 ZOOM 資訊。

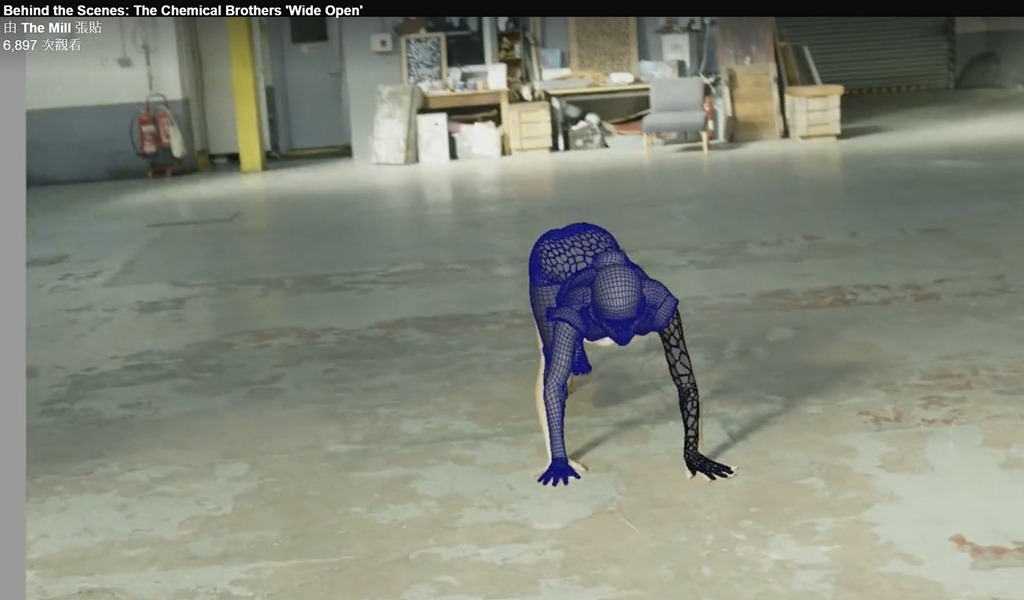

(2) 使用11台 GO PRO 攝影機來拍攝舞者的全角度動作讓動畫師手工硬跟。

(3) 請 FBFX Digital 公司來做舞者全身掃描建立精確的人體資料,方便之後來做 OBJ TRACKING 。

(4) 使用 XSENSE 來擷取舞者肢體動態檔案。XSENSE 是一間做 3D 空間 TRACKING 的領導廠商。

TRACKING 顧名思義就是追蹤的意思,通常泛指在後期取得攝影機動態資訊的製作環節,這裡則是特指,一個是拍攝者(攝影機)的動態資訊,一個是被攝物(舞者)的動態資訊,目的都是為了能在 3D 環境中重現實拍現場的所有細節資訊。(編)

LDS 英文全名是 Lens Data System ,是德國百年的電影器材巨擘 ARRI 開發用來記錄自家旗下數位攝影機資訊的系統,可以即時記錄拍攝時的攝影機動態、焦段等數據細節,在後製時可以利用這些資訊替換成 3D 環境的虛擬攝影機,對於後期工作有莫大幫助。(編)

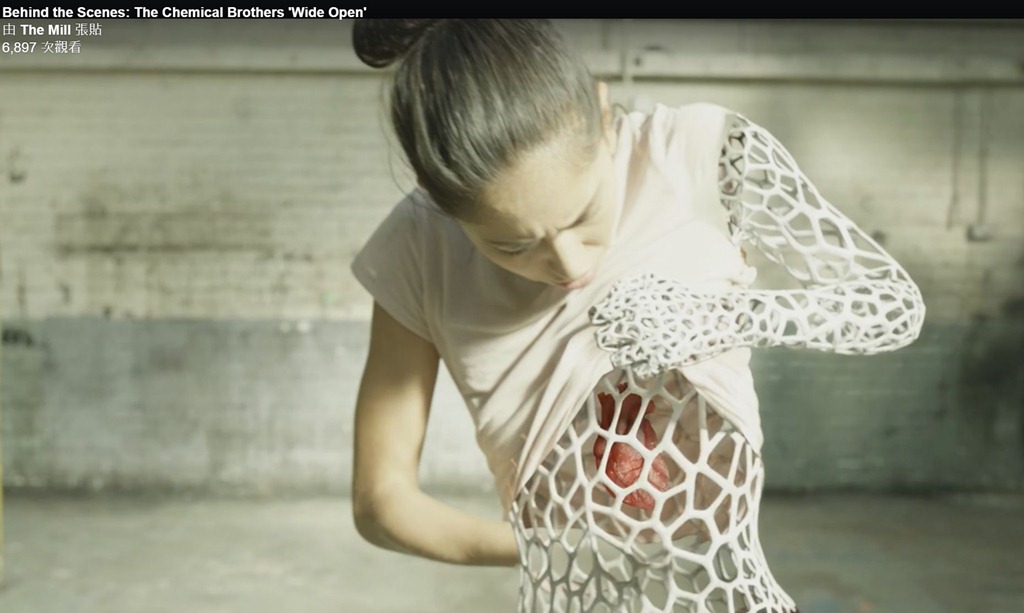

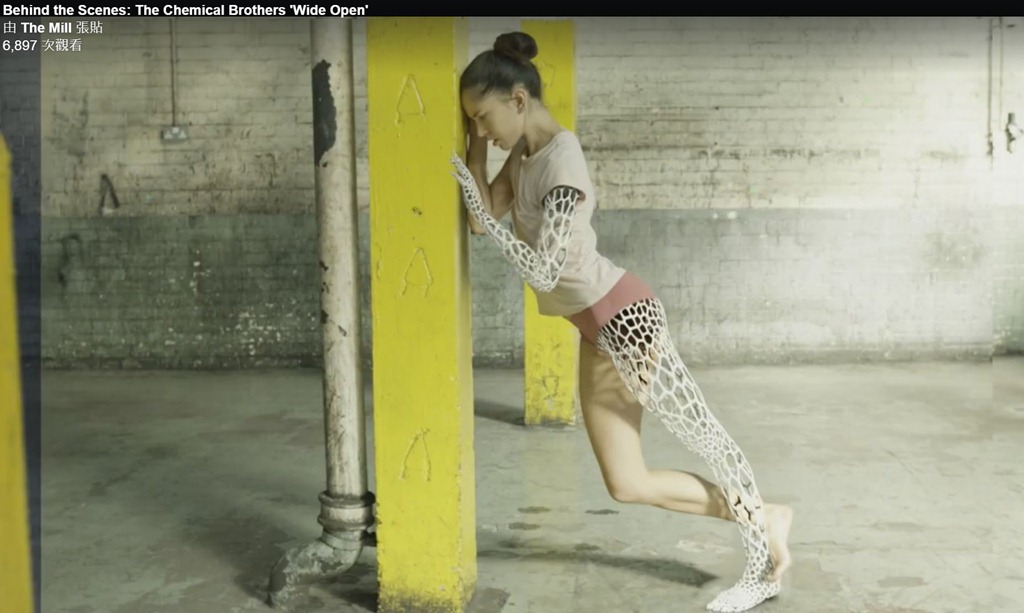

重點3 哪些地方是 CG

(1) 舞者全身。

(2) 舞者身上的 衣服 與 褲子 都是。連 The Mill 都說做了再多設定也硬追不起來,所以衣服、褲子都是 3D 模擬,再與實拍合成。

重點4 使用那些軟體

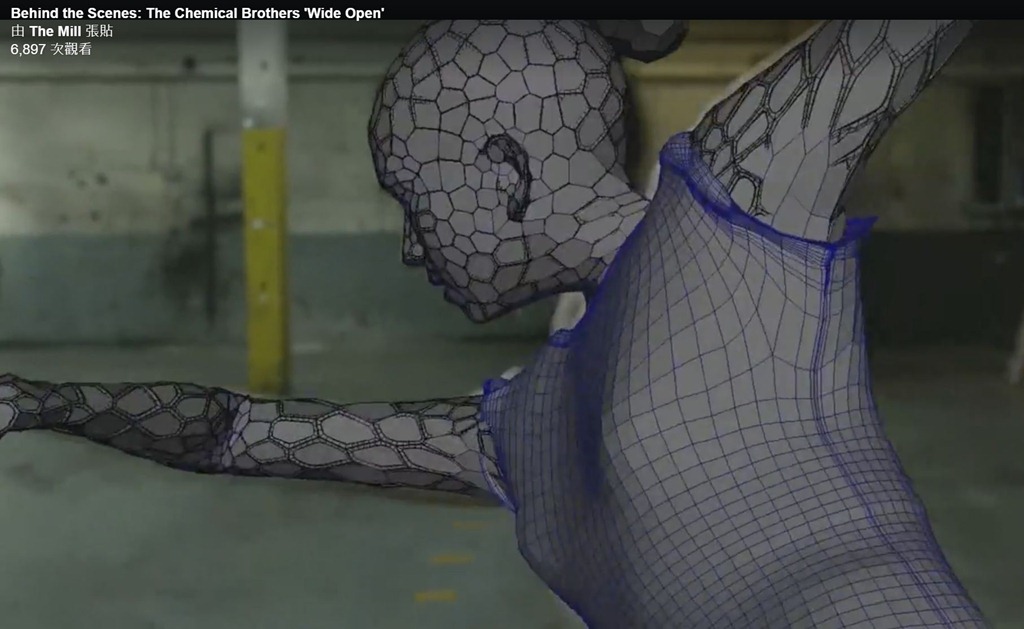

(1) 用 HOUDINI 快速產生骨骼4 肢的模型。

(2) 用 HOUDINI 開發新工具輔助將場景修乾淨。

(3) 用 Zbrush 刻細節。

(4) 到 Maya 整合處理。

(5) 用 Photoshop + MARI 畫貼圖。

(6) 用 Arnold 算圖。

(7) 用 Marvellous Designer 與 Maya NCloth 處理衣服特效。

(8) 用 Nuke 合成 + 處理物件投影。

接著我們再深入講以上這幾個重點的細節部分

4分半鐘的一鏡到底

Four and a half minutes shooting a single take

使用 ARRI 的 LDS 系統鏡頭可以將變焦資訊(ZOOM)的焦段、焦距、光圈等資訊都寫入到 METADATA 裡面,所以可以做到紀錄鏡頭與角色的距離資訊與變焦資訊而且也有助於在後期調出正確的景深。

補充:我問好幾年有無記錄攝影機 ZOOM 的方法,果然存在這種功能!主要重點是ZOOM的資訊非常重要,因為在 TRACKING 中 ZOOM 是一項非常棘手的問題,原來要搭配原廠 LDS 系列的鏡頭就能實現 ZOOM 的資訊紀錄,幾年前就思考過一般相機包含消費型的電子訊都能記錄在 EXIF 裡面了,為何 ARRI 的 METADATA 不會含這個東西?

這邊說明一下,一般物件在不同焦段的鏡頭下,一樣的東西會有不同的透視變化,而這種變形過程只要中間數據不對,那可能導致前後整段製作錯誤的嚴重問題,一個錯誤的距離資訊與會連帶整個透視的錯誤而導致特效或是動態都需要全部重做的狀況。

同一物體不同焦段的影像變化

至於焦距使用雷射測距儀只能紀錄靜態,動態對象根本無法紀錄!難道有人能能辦到以每秒24、30、60次的速度邊點邊記錄?手再快雷射逼逼來回都要好幾秒了,什麼時候台灣才可以不用用著 "大概的焦距" 、大概 "看起來對的比例" 、大概對著畫面 "手工硬對視覺修正" ?

舞者的數據收集

Dancer data

這段大概是說他們還使用了 LIDAR 的雷射技術掃描建立整個場景。要 TRACKING 這支作品的場景與鏡頭,如果沒有非常正確的攝影機與鏡頭資訊是很有難度的。因為拍攝這段影片現場架設許多雜物會導致後期合成修圖的工作很重,有了 LIDAR 的場景檔案再搭配 HDRI 算出正確的光源,可以有效應用於輔助場景底圖修乾淨的流程上。

補充:看到沒有連 The Mill 都說難了~ 別想說 "靠個 AUTO 點一下就能完成這種一鏡到底的鏡頭“ ,要用台灣這 10 年來的做法可以,那就別要求現在世界水準的效果與品質。

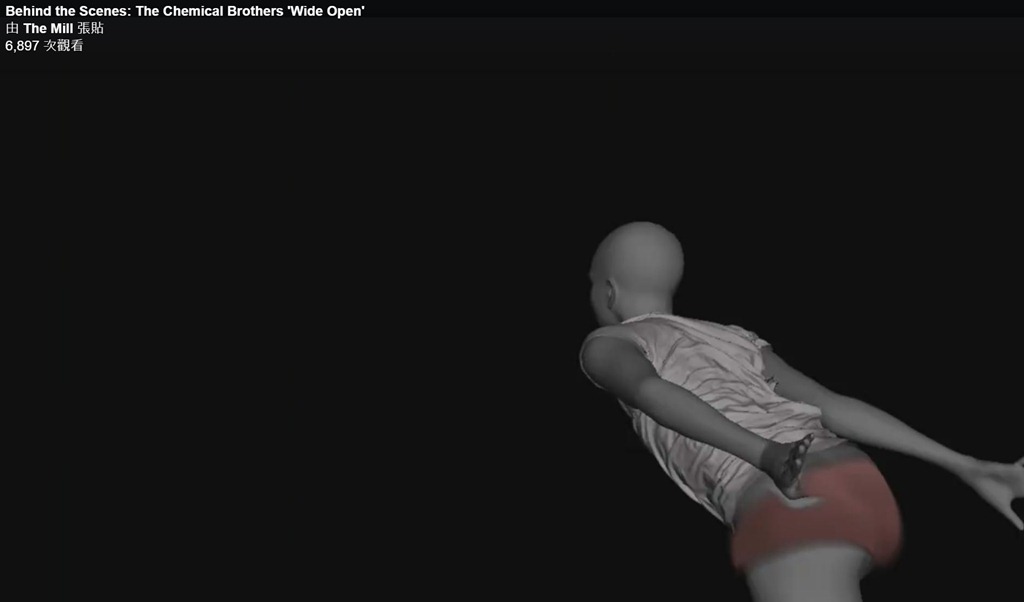

為了要更加精確 TRACKING ,他們找了 FBFX Digital 公司使用了 100 台單眼相機來掃描舞者準確的 3D 資訊,製作出精確的貼圖與數位替身,如此一來才能達到精確的人體 TRACKING 與填補替換上 CG 製作的身體物件(編:鏤空的肢體)。

很難精確的 Tracking 到完美

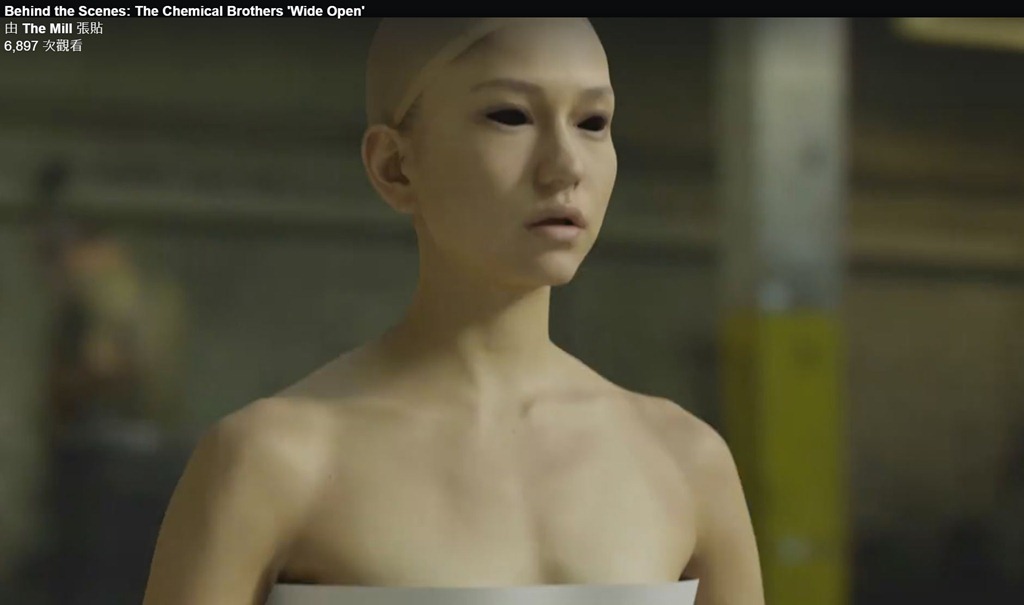

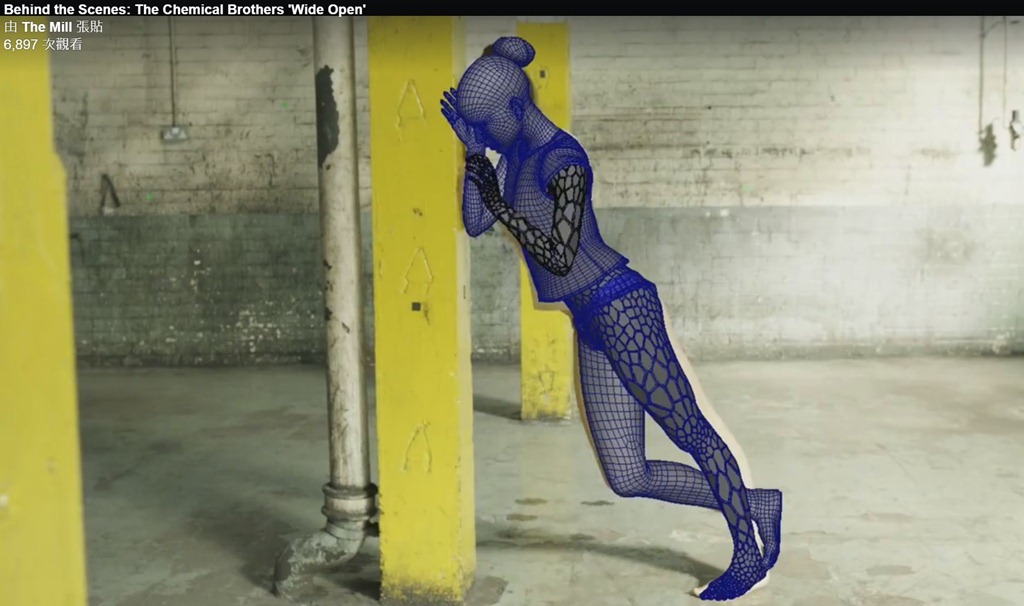

舞者 Sonoya 的數位替身 (Digital Doubles)

補充:這邊要說明一下,為什麼是 100 台的單眼相機?因為這個舞者掃描的 3D 模型這是透過同時捕捉的 100 張照片運算出來的結果。這時一定有人會想說,那是不是一台相機也可以一張張拍呢?沒錯,的確可以,但是一台相機只限於 "靜止物體" 的掃描。

因為人類是生物,除非是死人,不然不可能不動。當你換個角度拍攝的瞬間,就會因為身體不斷的呼吸、手部的微晃而造成最終成形失敗的誤差,例如手指黏在一起整隻手掌變成扇形之類的,所以才需要同時 100 台相機來捕捉。因為人是活生生的生物,因此變化是無法避免的,但這成本也已經比當年上千萬的 Lightstage 便宜很多了。當然,LIGHTSTAGE 還可以捕捉更多資訊與動態非這個裝置能相比。

補充:在國外的 Tracking 不只是貼貼 MARK 點丟進追蹤軟體 Tracking 而已,而且國外用 LIDAR 掃瞄場景或 3D 掃描已經有 10 年以上的經驗,所以也不能說是最新技術,但是要達到精確的、破綻少的品質還需要透過完整的 SCAN 或想辦法產生 LIDAR 之類的"精確"檔案才行,因為透過相機拍攝的資訊,會受到鏡頭的透視變形,片幅的裁剪影響,用一般的照片是無法拍出精準的尺寸物件(survey data),需透過 SCAN 或 LIDAR 來取得,再使用這些輔助資訊來修正 TRACKING 的精確度。

而台灣大多數的作法是只用 Bonjou、Sytheye、PFtrack 等追蹤軟體丟進去 AUTO TRACK 就開始亂塞,這只會增加來回修改與重作的時間成本。

好比說之前接過台灣某公司的電影外包,要補特效說 Tracking 他們會負責,還不准我插手…。結果鏡頭一來特效區域與反應物件區域真的是亂擺,整個動態與距離完全錯誤,我反映了,但他們堅持那是他們要的,最後該鏡頭光是來回修改新的鏡位、新的位置就前後4次,最後還是自己來…。

工商服務,台灣固態記憶 有掃描 model 這個服務,請洽 史萊姆 大大,他們也是 100 台單眼相機,純粹掃出來的 3D 檔案價格是一顆頭 3 萬,全身 7 萬,純粹精確的人體比例 3D 檔案而已,不含其他後期重新拓樸動畫用模型製作費用。LIDAR 技術服務在台灣高雄的日本 MO-CAP 公司 新月映像 有提供。

有時候我的要求真的不是無理取鬧~ 拿國外的作品說國外都做得到之前,請先看看有沒有足夠的預算,謝謝。

回到舞者 Sonoya 身上,The Mill 他們知道 Sonoya 會有很多幅度很大的肢體表演,為了讓數位替身的變化與真實的 Sonoya 更貼近,所以他們請 FBFX Digital 公司,掃描了 Sonoya 許多極限動作的 3D 模型做參考,用來抓出 Sonoya 最正確的肢體反應與肌肉變化,並在 MAYA 中串成 BlendShape 使用 RBF (已整合到最新的 SOUP 外掛中) 解算皮膚的真實變化。

所以不要看她腿凹的那麼自然,這可是用了全身掃描的技術所串出來的 3D 動態做參考,而不是只丟一個影片就對著硬幹到這種水準的品質。

除了找 FBFX Digital 做足事前的準備功夫之外,The Mill 還找了專精動態捕捉的 Peanut FX 在現場架設了 11 台 GO PRO 攝影機記錄 "每個角度的動態"(witness cameras) ,使用 48 fps 高速攝影來紀錄並當作 TRACKING 解算以及動畫師調動畫用的參考。

有了以上的東西:100 台相機串成的動態 3D 檔案,加上 11 台 GO PRO 相機給動畫師全方位一格一格硬 KEY 參考,還~ 不~ 夠~ 喔!The Mill 他們還想過用傳統的 MO-CAP 動作捕捉方案,但是卻覺得 MO-CAP 無法精準的記錄下每個動作,加上傳統的 MO-CAP 衣服對 Sonoya 來說實在太礙手礙腳,所以他們找來了自由度較高的 Xsens mo-cap ,在排練時擷取了幾個完整回合 Sonoya 的動態資訊做之後硬 key 的參考,底下影片可以看到他們的 Demo。

補充:或許他們曾想過此方案的檔案也能使用編修 MO-CAP 數據的方式再試著對回去,不過最後還是沒有採用此方法。這個態度就是:能不能用不敢保證~ 但真的能做的都要做…。

腦中回音:沒辦法,沒那個預算。沒辦法,演員不能配合。合約沒寫,沒辦法…. 對啦~ 3D 都有辦法啦… 沒錢的辦法就是找 3D 的辦法啦….

最艱難的部分

TRACKING

取得正確的姿勢資訊只是這場浩劫的50%而已。

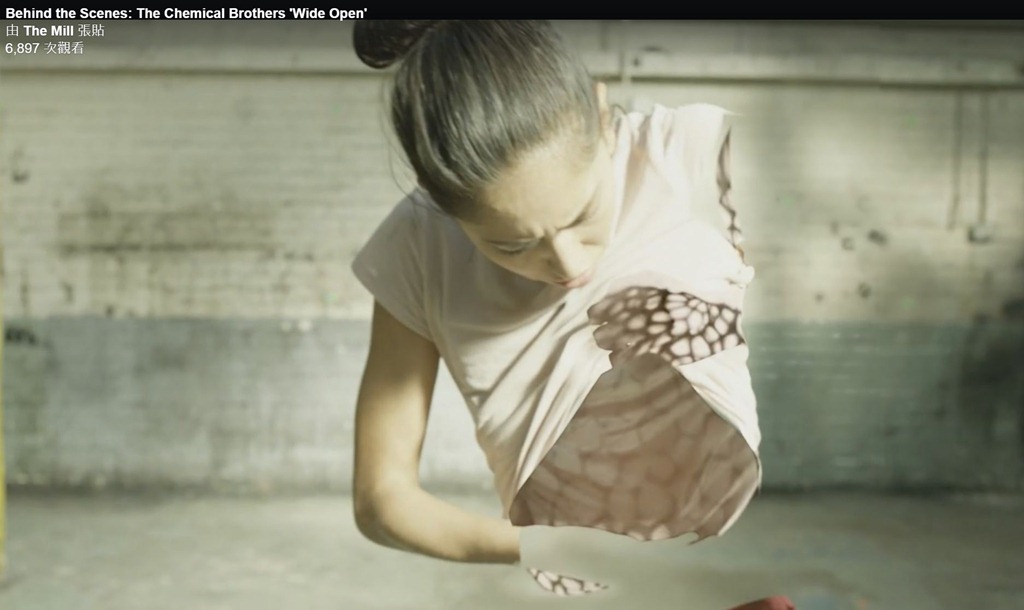

因為這支片的舞者 TRACKING 橫跨皮膚肌肉等技術,最明顯棘手的地方就是要將 CG 的身體硬跟(追蹤)舞者衣服的部分。Rigger 已經盡力想辦法在數位替身的模型上加入大量的控制器來看看有沒有辦法硬 key 硬跟,但他們最終意識到這效果根本有限,跟不起來。這也是為什麼這本片褲子大部分都是 3D 褲子的原因!

所以,就算有11個角度參考影片與 MO-CAP 資料了,但還是有高達 5800 格畫面需要微調硬修。

補充:啊,就說了啊… 跟不起來的地方就跟不起來,只能衣服或肢體全 3D 的蓋回去… 還說不可能?

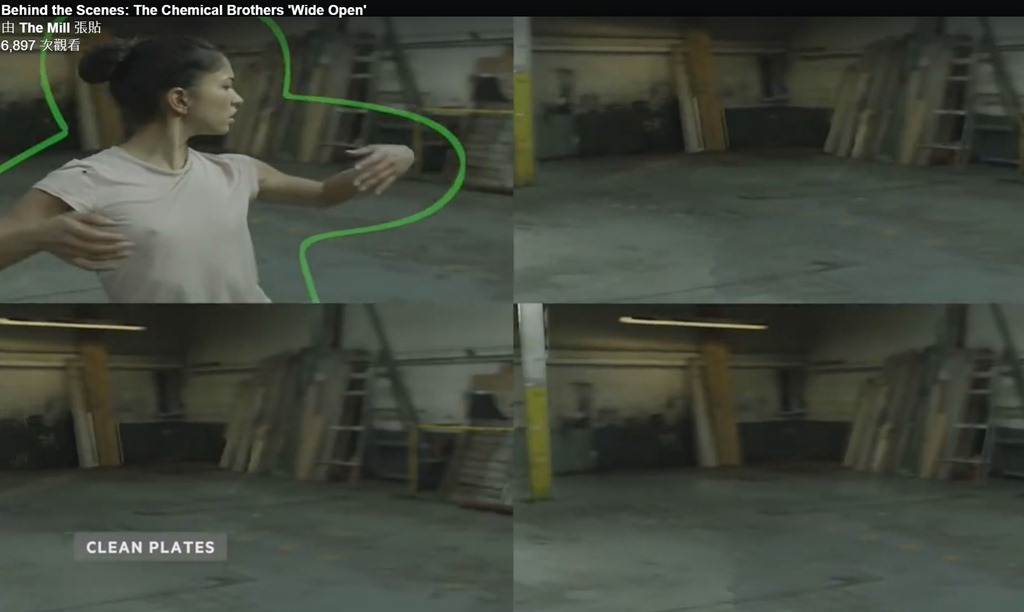

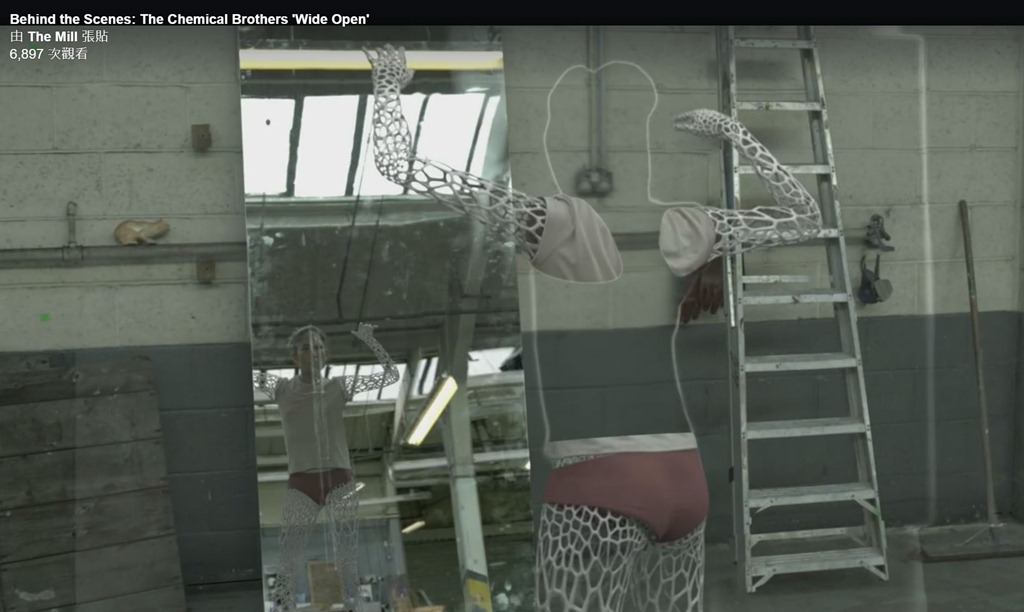

將場景中不要的東西修乾淨

Crafting a clean plate

現場塞了一堆東西(11台 GOPRO 啦、攝影機啦、XSENS啦….等)要 2D 一塊塊修實在工程浩大,所以採用先去 TRACKING 出 3D 攝影機的動態,搭配 LIDAR 的場景重建模型,用 Project 的方式投影貼回去,最後在2D中使用投影的 3D 模擬素材(projected pass)與實拍素材(main plate)之間產生乾淨的場景(hero clean plate)。

由於 MV 是採用自然光拍攝,所以會有時間上自然光光影的問題,這會牽扯到隨著拍攝時間光影不斷變化。為了解決這個問題,他們使用了 Houdini 並開發了一個工具。這個工具能通過指定要清除的區域,偵測前後張的變化,使用上面提到的 3D 模擬素材(projected pass)來將正確光影的物件補回去。

補充:HOUDINI 的功能都要開發的不是 HOUDINI 內建這個功能。

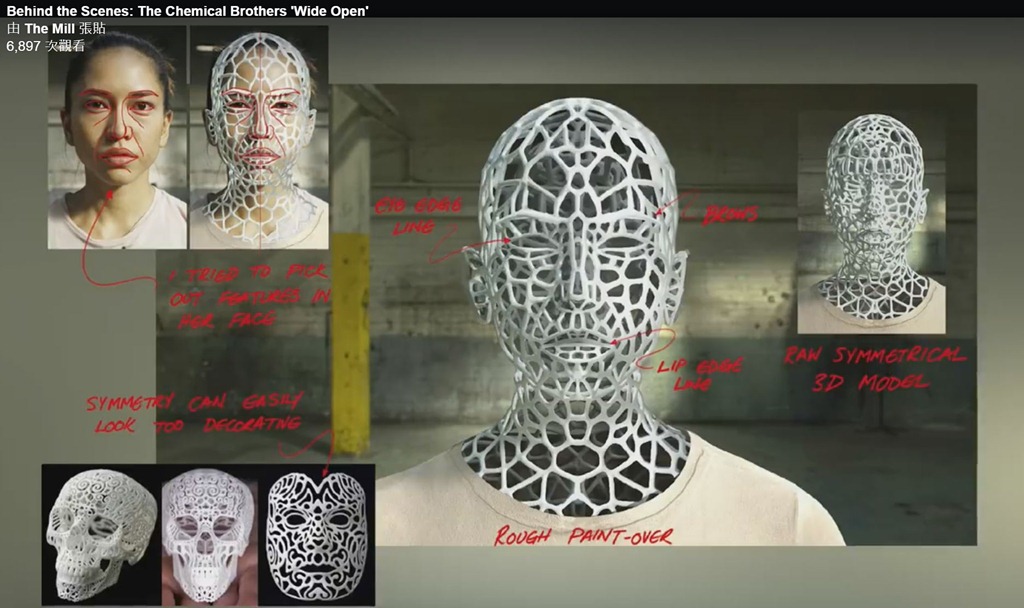

鏤空肢體的美術

3D-printed lattice body

設計非現實中的東西,你必須去思考如何在現實中轉換成理想的效果。

The design itself wasn’t really, It’s the kind of thing you have to rotate around to experience the desired effect.

美術是由得過艾美獎的概念設計師 Nathan Aardvark 負責,他提供了多種設計方案讓團隊與客戶討論這效果到可不可行,更難得的是,他還把整個接案到結案的過程畫成有趣的圖文,連結。(編)

繼續回到製作。關於模型 The Mill 先在 MAYA 中開始著手,但是他們意識到在 MAYA 中做這種骨骼的 MODEL 很難回頭修改。他們也試著用 MAYA 的神外掛 SOuP 來加速建模的製作流程,但很快地就意識到越變越複雜,效率越慢。試了一輪,最終選擇 Houdini 來製作模型。

畢竟老胡的強大節點編輯,可以快速產生修改許多版本,做完再丟到 ZBRUSH 刻細節,最後再回丟到 MAYA 中處理。總之,再說一遍,用 HOUDINI 快速產生骨骼的模型,用 ZB 刻細節,到 MAYA 整合處理,用 PS + MARI 畫貼圖,用 Arnold 算圖,用 Marvellous Designer 與 Maya NCloth 處理衣服特效。另外為了好看的皮膚變形,他們還開發了自家的一套 Warp 外掛。

攪合在一塊兒

Meshing it altogether

最後,你還要把這一堆素材給兜在一起才是呈現在觀眾眼前的東西。

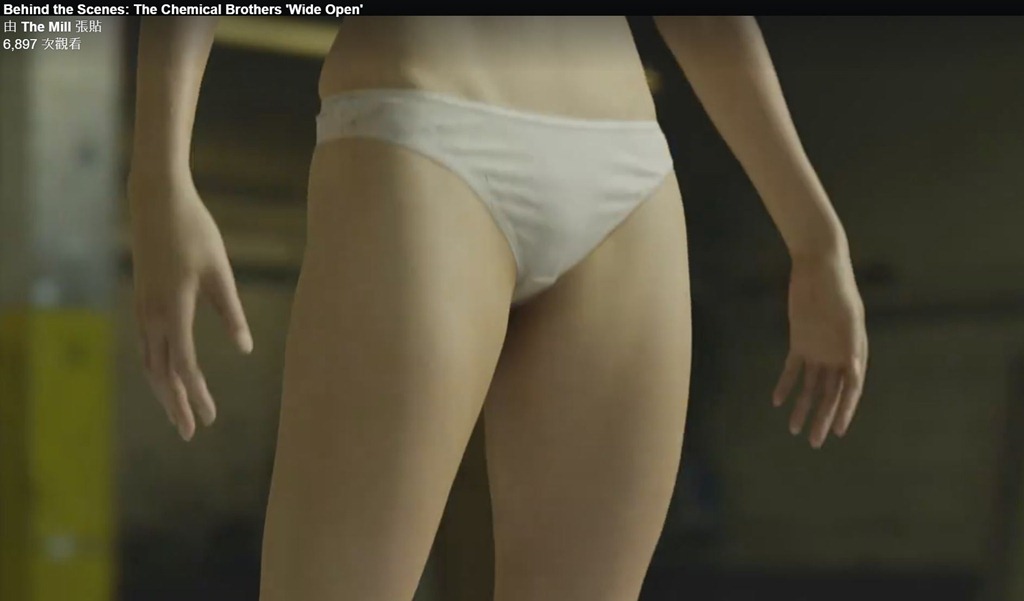

這種鏤空骨骼表現方式也在合成上面臨巨大挑戰,合成時必須去處理光線因為骨骼產生的寫實影子的合成問題,而且為了達到完美效果,影子必須要全身都要跟到,而不只是雙手雙腳。另外一個挑戰是影子與舞者衣服的互動,最後,他們決定連衣服都全 CG 啦….。很重要所以要說三遍~

就說啦 fully CG underwear….

就說啦 fully CG underwear….

就說啦 fully CG underwear….

誰說不可能?已實證非我胡亂腦補推理,The Mill 親口說的,謝謝。

為了這一點,他們在 NUKE 中將實拍素材直接投影在模擬完的 3D 物件上進行合成,這個方案大大增加了合成上的彈性,不但可以隨意增加寫實的影子,也能很自然的移除原始舞者的輪廓、接縫...等,讓 CG 身體與鏤空部分更加貼合真實。

大功才告成!

編輯補充

Q:為何不乾脆全做3D然後再擺攝影機進去,也許可以省略複雜的Tracking,只抓舞者動態就好,或許方便許多? 感謝網友薄季凡的問題。

A:可以從兩個方向來分析

1. 技術上,人體(尤其是頭部)是非常複雜的有機組合,臉部表情、一顰一笑、皺紋細紋、眼睛(靈魂)與頭髮(髮絲)的寫實都有一定難度,靜態也許還算容易(不過通常算個一張很逼真的 CG 角色,大家會就高潮了,難度可見一般),但是動起來要做到真實可信,而且還要充滿感情,並且在特寫鏡頭時毫無破綻,我只能說非常非常非常難。即便是好萊屋的特效大片也相當罕見用數位替身來演出特寫鏡頭,通常還是應用在快速轉換、充滿動態模糊的戰鬥場面居多,更何況這只是一支 MV。

另外,還有個有趣的點可以觀察"頭部"有多難 CG 化。舞者的四肢與身體在替換成鏤空 CG 時,都是在鏡內完成(好厲害啊啊啊啊),但是只有在替亂頭部時,導演特意安排了出鏡的切換去避開。

2. 藝術上,導演應該會堅持現場拍攝的素材做為影像基礎,即便後期可以做到幾可亂真,但我想導演應該還是喜歡自己親手從攝影機記錄的影像吧(?)。

回到問題,Wide open 特效的主要困難點還是在:如何在一鏡到底的情況下換掉舞者四肢到虛擬肢體這個部份,所以用全3D去模擬真實舞者並不是他想挑戰的。我想影片中,只要是舞者肉體的部分應該都是實拍素材(main plate)。另外再補充王谷神前輩的說明:「應該是說,完全用 CG 的部分不用對很準沒關係,完全用 footage (實拍素材)的部分也不用對很準沒關係,需要對很準的是 CG 跟 footage 有 interact 交錯的部分,像是 CG 左腳的影子要加在 footage 右腳上,你就要弄一個對很準的 CG 右腳去接這個影子。」

底下這張圖片應該還滿明顯的,四肢與四肢相接的衣服是 3D,其他舞者身體衣服與頭部還是用實拍素材。

參考資料:

fxguide:So, just how was that Chemical Brothers video made?

Behind The Project: How The Mill Brought The Chemical Brothers' 'Wide Open' To Life

編輯

Edit BY SHIH-YAO