2020 奧斯卡 - 最佳視覺效果獎入圍者 - 特效解析

© all photos courtesy of WIRED / MPC / Disney / ILM / Weta Digital / Digital Domain / The Oscars 2020 / 92nd Academy Awards

( 圖一 )

本文講者 Kevin Baillie 是 Atomic Fiction 創辦人 / Method Studios 視效總監 (圖一)

Kevin Baillie 說 : 今年奧斯卡最佳視覺效果獎的入圍名單非常精彩,因為整個名單非常多元,涵蓋的技術包羅萬象。有數位角色的特效 (digital characters)、有把人變年輕的特效 (de-aging)、有隱形的特效 (invisible effects)、有實拍的特效 (practical effects)、也有把實拍攝影導入虛擬製程的特效 (virtual production)。

《復仇者聯盟 4:終局之戰》 (Avengers : Endgame)

( 圖二 )

Kevin Baillie 說 : 為了體現教授浩克 (Smart Hulk) 這個全新的角色,特效團隊運用了最新的人工智慧技術。以前的動態捕捉,角色的表演是由演員臉上的點所驅動的,但這些點與點之間時常會有遺漏的資訊,導致整個角色看起來假假的,但現在因為有機器學習 (machine learning) 我們可以教電腦,臉應該要怎麼動,所以當演員頭戴攝影機,臉上貼點表演時 (圖二),其實捕捉的資訊不用太多,只要把演員表演的要旨輸入到機器學習的演算法 (maching learning algorithms) 裡,電腦就會去自動分析,臉應該要怎麼動,自動把點與點之間沒捕捉到的資訊補齊,最後這些資訊就會變成教授浩克 (Smart Hulk) 傳神的表演。

(圖三)

(圖四)

(圖五)

但是表演要傳神,其實機器學習 (machine learning) 的前製作業是要花非常多時間的。我們須要給電腦大量的資訊,我們叫這些資訊「訓練資料」 (training data) 。我們會先用非常高解析度的攝影機把演員的 3D 樣貌掃描出來 (圖三),然後會再請演員做出各種不同的表情變化 (facial range of motion) 例如哭到笑、笑到氣 (圖四) ,這是最花時間的步驟,然後我們會再把上百種表情下,毛細孔、肌肉、皺紋的變化全部輸入到電腦中 (圖五),這會用掉億萬位元組的資訊 (terabytes of data) ,這讓我們可以只要捕捉少量的「現場資料」,再比對大量的「訓練資料」就能塑造出傳神的數位角色。

《星際大戰:天行者的崛起》(Star Wars : The Rise of Skywalker)

(圖六)

(圖七)

Kevin Baillie 說 : 《星際大戰》是奇幻電影的代表作,但為了讓人們相信這個奇幻世界是真的,它的特效就必須更寫實。這部片花了非常大的力氣去執行這件事,所以它用了非常多的機械木偶、實拍模型 (圖六)、真實搭景 (圖七)。我覺得完美結合實拍跟後製一直都存在星際大戰的基因中 (Star Wars DNA),所以決定那些地方要用實拍的、哪些地方要用後製的,永遠都是這一系列電影的一大挑戰。

(圖八)

(圖九)

有一場發生在海中死星上的戲,特效總監 Roger Guyette 和他的團隊就必須決定哪些海水要用真的,哪些要用後製作的,最後他們決定保留少部分真的海水,大部份海水都用後製的 (圖八)。對特效團隊來說最重要的是,演員能跟真的東西互動,像那些激起的浪花,真的濺到演員身上 (圖九),是最後特效看起來寫實的關鍵。

我在做星際大戰第一集的時候,有些技術還未成熟,我們當時會問,這個東西做得出來嗎? 但是現在技術已經進步很多了,我們就應該問,這個東西要怎麼做才比較恰當。我認為《星際大戰》是特效用的恰如其分的最好範例。

《1917》(1917)

Kevin Baillie 說 : 如果你認為《1917》沒有用到什麼特效,那你就大錯特錯了,這部片從頭到尾都是特效,這是一部一鏡到底,看起來像沒有剪接的電影,光是這點特效團隊就要花非常多的功夫。這部片在各種不同的景點拍攝,有室外、有室內、也有片場,也在不同的時段拍攝,有清晨、有中午、有晚上,如何把這一切銜接起來,讓它看起來是順暢的,全要歸功於特效團隊。

(圖十)

(圖十一)

(圖十二)

談到銜接,有一場主角從一個村莊中逃出,從一座橋上跳下,落入一個喘急河流中的戲,主角在橋上時是真人 (圖十),往下跳時變成數位人 (圖十一),到河流中又變回真人 (圖十二),這一切都是一鏡到底,但卻是在不同日子、不同地點拍的,這只是數千個要花數百個小時完成的特效鏡頭中的一個例子。

(圖十三)

除了角色的銜接,場景也要花非常多功夫製作,這部片發生在一戰時期,像地上的坑洞、廢鐵、坦克、子彈全都是用特效做的 (圖十三),但這些特效一點都不浮誇,也可以說根本看不出是特效,我們叫這種特效「隱形的特效」,它是輔助故事用的,而不是故事本身,這反而是我最喜歡的特效類型。

《愛爾蘭人》(The Irishman)

(圖十四)

(圖十五)

Kevin Baillie 說 :《愛爾蘭人》是一部角色會歷經青年、中年、老年不同人生階段的電影,這部片也因為這項「把演員變年輕」 (de-aging) 的技術而入圍這次的奧斯卡,但 Martin Scorsese 不想用到動態捕捉,他只想像一部正常電影一樣拍攝這部片,於是特效總監 Pablo Helman 和他的團隊就寫了一個叫 Flux 的軟體。這個軟體取材於現場演員真實的表演,然後它會把一個年輕版的數位面具貼到真實演員的臉上 (圖十四),然後這個數位面具會再參考演員年輕時的影片與照片下去製作 (圖十五),最後為了讓這個數位面具能成功定位,他們會用不只一台,而是三台攝影機拍攝 (圖十六)。

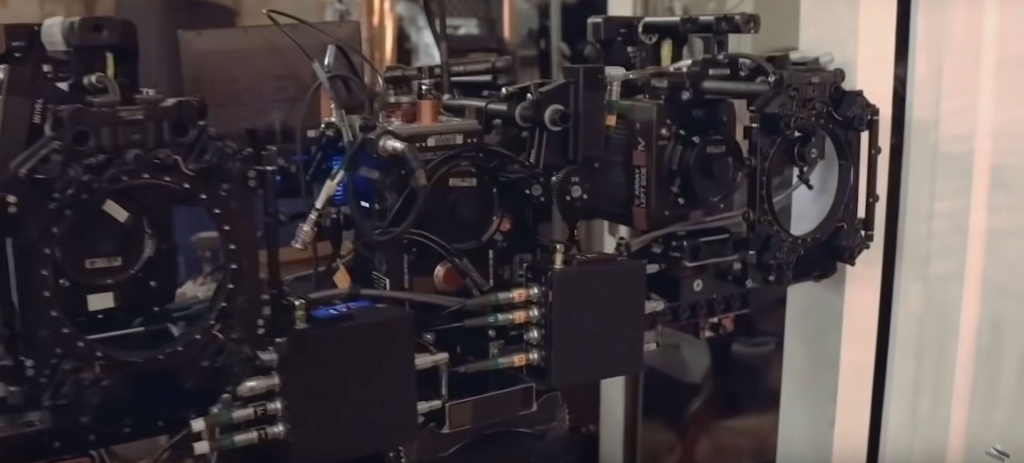

(圖十六)

中間的攝影機是一台正常的攝影機,然後兩旁的側拍機 (witness camera) 能拍出紅外線影像 (infrared footage) (圖十七),所以就算導演為了氣氛,演員有一半的臉在陰影中,紅外線還是能順利捕捉到角色完整的輪廓,成功做出年輕版的數位人。

(圖十七)

我認為演員能成功演出年輕版的自己,對產業後續發展影響很大,或許未來選角就可以只看個性,不用顧慮到年紀。但有人就會問,用數位人取代演員有道德上的問題嗎? 我認為數位人是不可能取代演員的,《愛爾蘭人》就是最好的證明,再厲害的特效都做不出 Robert Deniro 那種層次的表演,觀眾有共鳴的也一直都是演員真誠的表演,所以我覺得《愛爾蘭人》 中的新科技不會取代,反而是會幫助、提升、強化演員。這個新科技反而是在替演員、創作者、產業開一條新路。

《獅子王》(The Lion King)

(圖十八)

Kevin Baillie 說 : 《獅子王》特效總監 Rob Legato 做了一個「全虛擬」的非洲世界 (圖十八),但是一部「全虛擬」電影的危險性是,最後畫面會很容易像「電腦遊戲」,不管畫面多寫實,如果攝影機的運動違背了物理原理,如果畫面中的光線違背了攝影原理,整部片看起來就會不對。

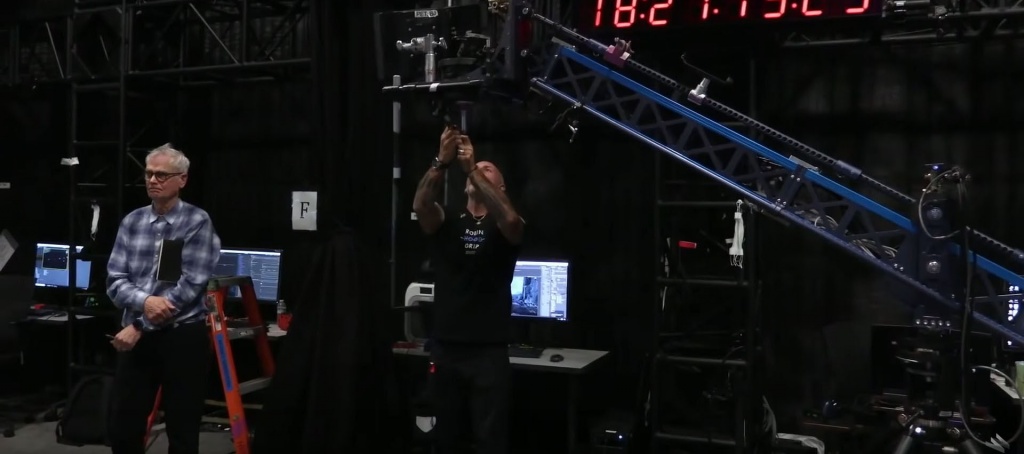

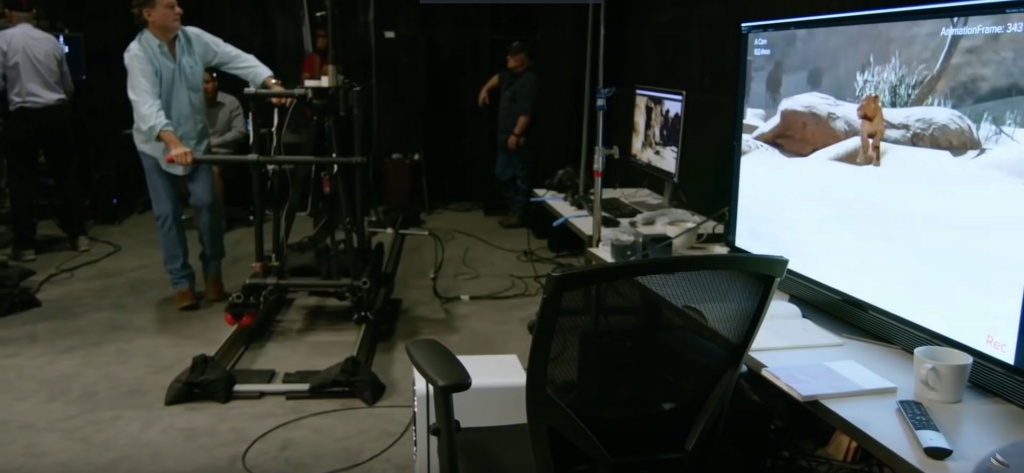

(圖十九)

(圖二十)

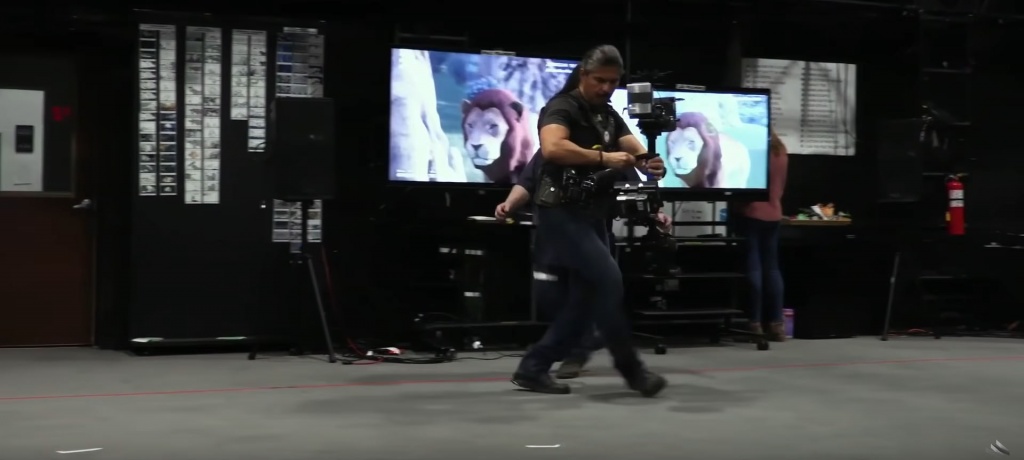

(圖二十一)

所以 Rob Legato 與他的團隊設計了一套讓劇組可以在攝影棚中操控的裝置,這個裝置可以接上真實世界的機器手臂 (cranes) (圖十九)、軌道車 (dollies) (圖二十)、穩定器 (steadicam) (圖二十一) 而且會去驅動「虛擬世界」裡的「數位攝影機」,因為「數位攝影機」背後是人在操控,這讓電影中的攝影機運動變的不完美,也讓「全虛擬」的電影多一點我們熟悉的人味。